고정 헤더 영역

상세 컨텐츠

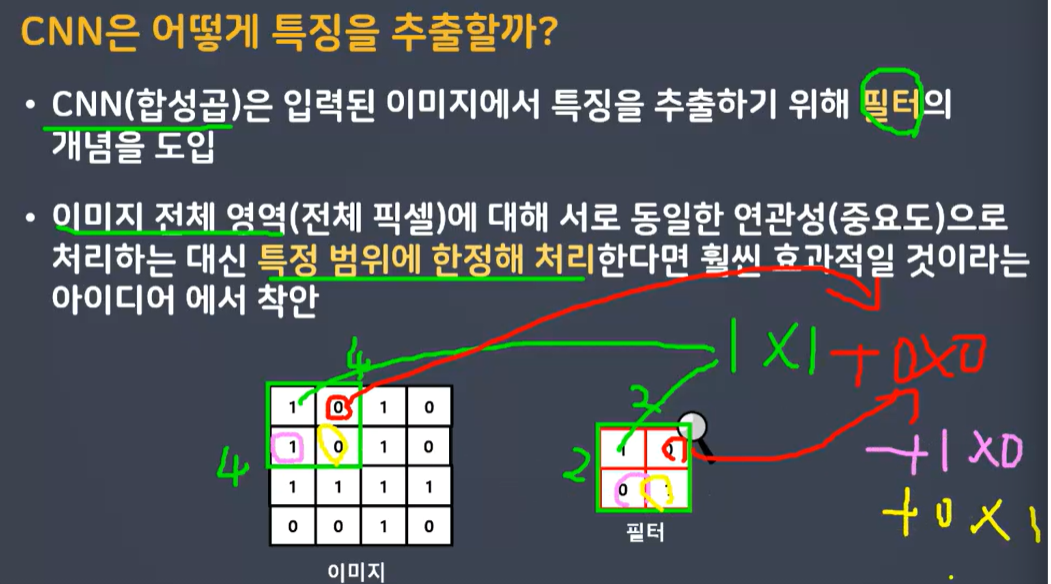

본문

CNN

- 고양이의 눈으로 보는 사물의 형태에 따라 뇌의 특정영역(특정뉴런) 만 활성화

된다는 실험 결과를 기반으로 제안

- 2010~ 2013년도 CNN의 획기적인 발전과 다수의 논문 출시

이미지 데이터에서 색상의 개념

- 합성곱 계층에서 이미지의 색상 정보를 채널이라고 부름

- 흑백으로 코딩 된경우(ex 손글씨 이미지) 흑백의 그레이 스케일

( 0: 검은색, 255:흰색)만 나타내면 되므로 채널은 1이 됨

- 입력신호가 RGB 신호로 코딩된 경우, 채널은 세가지 색을 각각 나타내는 3이됨

패딩(Padding)

- 필터의 크기로 인해 가장자리 부분의 데이터가 부족해서 입력과 출력의

이미지 크기가 달라지게 되는데

- 이를 보완하기 위해서 입력데이터의 가장자리 부분에 0을 미리 채워 넣는것을

패딩(padding)이라고 함

- 패딩을 사용하면 입력과 출력의 크기를 같게 맞춰 줄 수 있음

- 층이 깊어지면서 이미지의 크기가 줄어드는 것을 방지

- Conv2D 계층에서는 padding 명령을 사용해 패딩을 지정할 수 있음

-> same을 지정하면 출력과 입력이 같아지게 적절한 수의 패딩을 자동으로 입력

-> valid로 설정하면 패딩을 사용하지 말라는 뜻

축소샘플링

- 합성곱을 수행한 결과 신호를 다음 계층으로 전달할 때, 모든 정보를 전달하지 않고

일부만 샘플링 하여 넘겨주는 작업을 축소 샘플링이라고함

- 축소 샘플링을 하는 이유는 좀 더 가치 있는 정보만을 다음 단계로 넘겨주기 위함

- 딥러닝에서 원하는 결과를 얻기 위해서는 가치 있는 정보를 줄여가야 하며,

결국 핵심 정보만 다음 계층으로 전달 하는 장치가 필요함

- 축소 샘플링에는 크게 스트라이드와 풀링 두가지 기법이있음

전이 학습 - 특성추출방식

- CNN 층에서 특성추출부만 가져와서 사용하는 방식

- 특성추출부 부분만 사용하는 이유는 분류기(MLP)의 경우 우리가 해결하고자 하는 문제에 맞게

새로 설정해줘야 하기 때문

- 단, 새롭게 분류할 클래스의 종류가 사전 학습에 사용된 데이터와 특징이 매우 다르면, 특성 추출부 전체를 재사용 해서는 안되고 앞 단의 일부 계층만을 재상용해야함 (심플한 특징들만 추출해내기 위해)

전이학습 - 미세조정방식

- '사전 학습된 모델의 가중치'를 목적에 맞게 전체 또는 일부를 재학습 시키는 방식

- 특성 추출부의 층들 중 하단부 몇개의 계층은 전결합층 분류기(MLP)와 함께 새로 학습시킴

- 처음부터 특성추출부 계층들과 분류기(MLP)를 같이 훈련시키면 새롭게 만든 분류기에서 발생하는 큰 에러 값으로 인해, 특성 추출부에서 사전 학습된 가중치가 많이 손실될 수 있음

- 처음에는 분류기(MLP)의 피라미터가 랜덤하게 초기화 되어 있으므로 컨볼루션 베이스 중 앞 단 계층들을 고정(동결)하고 뒷단의 일부 계층만 학습이 가능하게 설정한 후, MLP와 같이 학습시켜 피라미터(w,b)들을 적당하게 잡아줌

'빅데이터, AI' 카테고리의 다른 글

| RNN(순환신경망)/개념/사용법 (0) | 2023.03.20 |

|---|---|

| 신경망 성능 개선 (0) | 2023.03.15 |

| 오차 역전파(Back Propagation) / 최적화함수(Optimizer) (1) | 2023.03.13 |

| 활성화함수/개념/종류 (0) | 2023.03.10 |

| 딥러닝 개념 (0) | 2023.03.09 |